コレスポンデンス分析における特異値分解(SVD: Singular Value Decomposition)は、単にクロス集計表の中で「もっとも大きな数字を炙り出す」ことを目的とした手法ではありません。むしろ、カテゴリ間の関連性を軸として視覚的に説明するための方法です。

コレスポンデンス分析は、行と列(例えば髪の色と目の色)の間の関連性を捉え、次元削減を行うことによって、その関連を低次元(通常は2次元)で視覚化します。この過程で特異値分解が行われ、クロス集計表(行列)の構造をより簡潔に説明できる軸(主成分)を抽出します。

特異値分解により、クロス集計表は複数の独立した成分(次元)に分解され、データに含まれるパターンのうち、重要なものが抽出されます。特異値が大きい成分ほど、行列の構造に対する寄与度が高く、これがデータの背後にある主要なパターンを示します。

そのため、特異値分解は「もっとも大きな数字を炙り出す」というよりも、クロス集計表の背後にある「カテゴリ間のパターン」を説明するための軸を見つけるプロセスと捉えるのが正しいです。この軸を使って、髪の色や目の色のカテゴリがどのように関連しているかを視覚化したり、説明したりすることが可能になります。

軸を抽出

コレスポンデンス分析における特異値分解(SVD)では、クロス集計表の「1番大きな数値」自体を軸の極として直接使うわけではありません。

正確には、クロス集計表の「頻度の分布」をもとに、行と列の間の関連性を数値的に捉え、その関連性を反映した「軸」を抽出するプロセスです。この軸は、行列全体の構造(パターン)を説明するためのもので、単に1つの大きな数値だけに基づいているわけではありません。

SVDの結果として得られる軸(主成分軸)は、クロス集計表全体の分散を最大限に捉えるように設計されています。つまり、データ全体の構造を説明するために、最も重要なパターンが抽出されます。特異値(SVDの結果として得られる値)が大きい軸は、そのパターンに対して大きな寄与を持っており、特異値が小さい軸は寄与が少ないパターンを表します。

したがって、特異値が大きい軸は重要なパターンを反映していますが、それは「1番大きな数値」を軸の極として使うという単純な話ではなく、クロス集計表全体の背後にある関連性や構造を捉えるためのものです。

この軸を使って、行(髪の色)と列(目の色)の間の関連性を低次元に落とし込み、例えば2次元のプロットとして視覚化することができ、これにより、データ内の主要なパターンや関係が分かりやすくなります。

大きな数値を取ってるわけではない?

コレスポンデンス分析では、クロス集計表の生のデータをそのまま使うのではなく、行の合計や列の合計、全体の合計から派生した数値(たとえば、割合や乖離など)を元にデータを加工し、その結果から重要なパターンを見つけるという点では正しいです。

具体的には、次のような手順が含まれています。

- 相対度数の計算:

- 元のクロス集計表を全体の合計で割り、各セルの相対度数を計算します。これにより、各セルが全体に占める割合を示します。

- 行と列の重心(マージナル確率):

- 行と列の合計を計算し、それを「行の重心」や「列の重心」として扱います。これは各行や列が全体の中でどれくらいの割合を占めるかを示します。

- 行列の標準化:

- 各セルの相対度数から行と列の重心を引いた差分(偏差)を計算します。これにより、個々のデータ点が全体の平均からどれくらい乖離しているかを評価します。

- 特異値分解(SVD):

- この標準化された行列に特異値分解を適用します。SVDでは、行列を特定の軸(主成分)に分解し、データの背後にあるパターンを抽出します。ここで、特異値が大きい軸は、データ内で最も重要なパターンを表し、その軸を使ってデータを視覚化することができます。

重要なのは、このプロセス全体が、クロス集計表の数値を元にして、その数値を加工・変換し、最も大きな「パターン」を捉える軸を見つけることです。これには、元の数値の大きさだけではなく、全体に対する相対的な重要性(乖離や偏差)などが考慮されます。

したがって、**「大きな数値を軸としてとっている」**という表現は、元の数値を加工した後の「重要なパターン」を捉える軸を抽出するという意味で、確かに関連していますが、直接的に大きな数値だけを選んでいるわけではない、という点も重要です。

標準化

コレスポンデンス分析では、クロス集計表を元に標準化した数値から大きなパターン(つまり、重要な数値の差や乖離)を抽出し、それを特異値分解(SVD)によって軸として取り出しているというのが正確な説明です。

具体的に言うと、特異値分解(SVD)は、データの「ばらつき」や「関連性」をうまく捉えるために使われ、その中で大きな特異値(軸に対する重要度の指標)は、データの背後にあるもっとも重要なパターンを示しています。この軸を使って、行と列(例えば、髪の色と目の色)の間の関連性を説明します。

したがって、標準化した数値の中で重要な(大きな)パターンを捉え、そのパターンに基づいた軸を特異値分解によって見つけ出しているということです。

コレスポンデンスとSVD

特異値分解(SVD)自体のプロセスには「相対度数を計算する」というステップは含まれていません。特異値分解はあくまで、行列の分解手法であり、入力として与えられた行列に対して直接的な分解を行います。ですので、SVDの前に行うデータの前処理が重要になります。

しかし、コレスポンデンス分析の場合、SVDの前にデータの標準化や行・列の合計に基づく補正が行われるため、質問の例でいう「相対度数を割り出す」というのはコレスポンデンス分析特有の前処理に相当します。この段階で、クロス集計表から得られた「相対的な重要性」や「乖離」を反映したデータが作られ、その上でSVDが適用されるのです。

コレスポンデンス分析における標準化とSVD

- クロス集計表の標準化:

- コレスポンデンス分析では、まずクロス集計表の各セルに対して「行と列の合計」に基づいた標準化が行われます。この標準化の目的は、行と列のカテゴリの影響を均等化し、カテゴリ間の相対的な関連性を強調することです。

- SVDの適用:

- 標準化された行列を使って、特異値分解を行います。この時点でSVDは、単に与えられた行列を分解し、最も重要なパターンを抽出する手法として使われます。

- 特異値(Singular Values)が大きいほど、そのパターンがデータの中で重要であり、その軸が主要な次元(主成分)になります。

まとめ

- **特異値分解(SVD)**は、前処理された行列に対して行われ、そこで「大きな数値」を抽出することでデータの構造を説明する軸を得ます。

- コレスポンデンス分析では、相対度数や標準化といった前処理が行われるため、これが一見「相対度数を割り出すプロセス」に見えるかもしれませんが、これはSVDの一部ではなく、コレスポンデンス分析の特有のステップです。

特異値分解自体は、このような前処理を必ずしも必要とせず、どのような行列にも適用できますが、コレスポンデンス分析の文脈では、特定の前処理が加えられているということです。

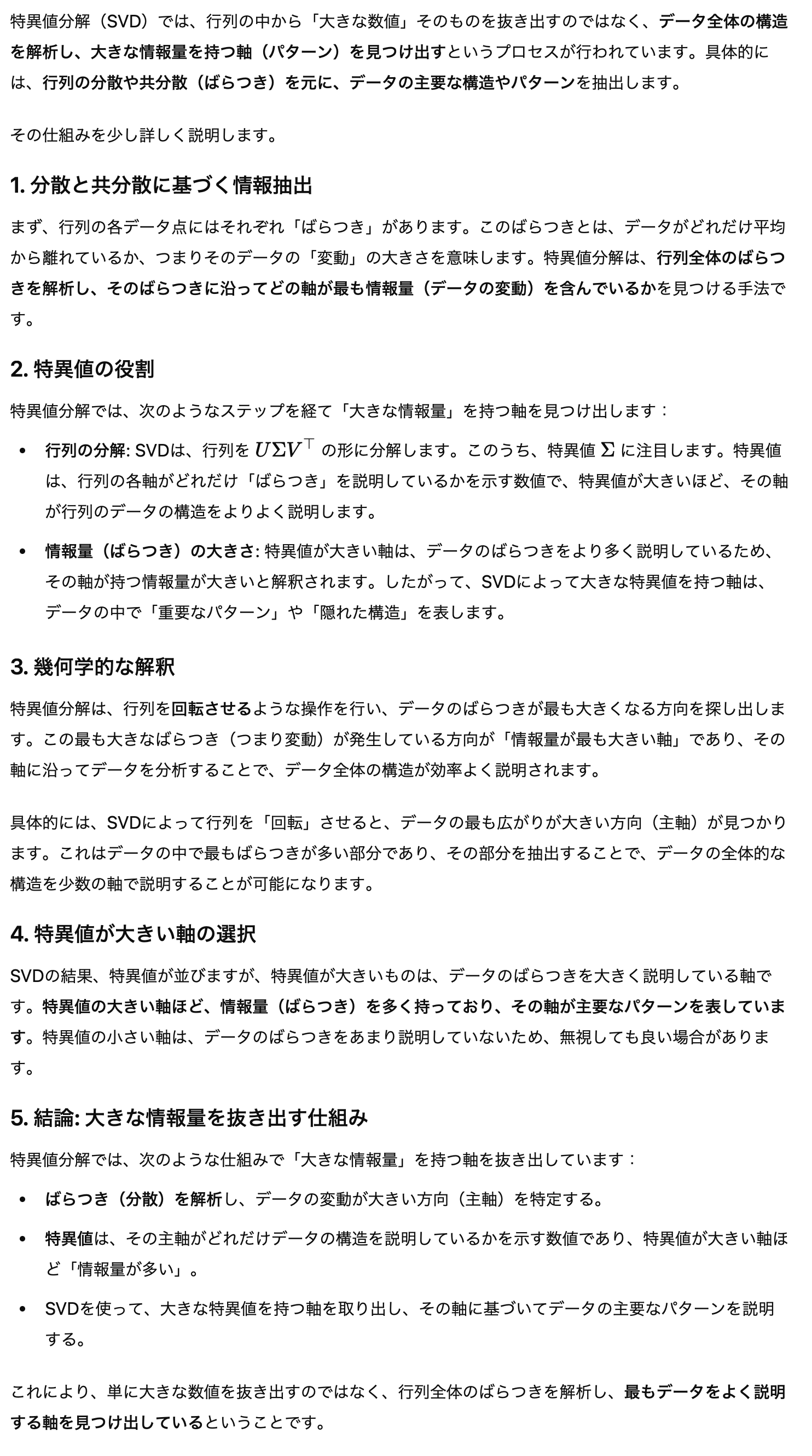

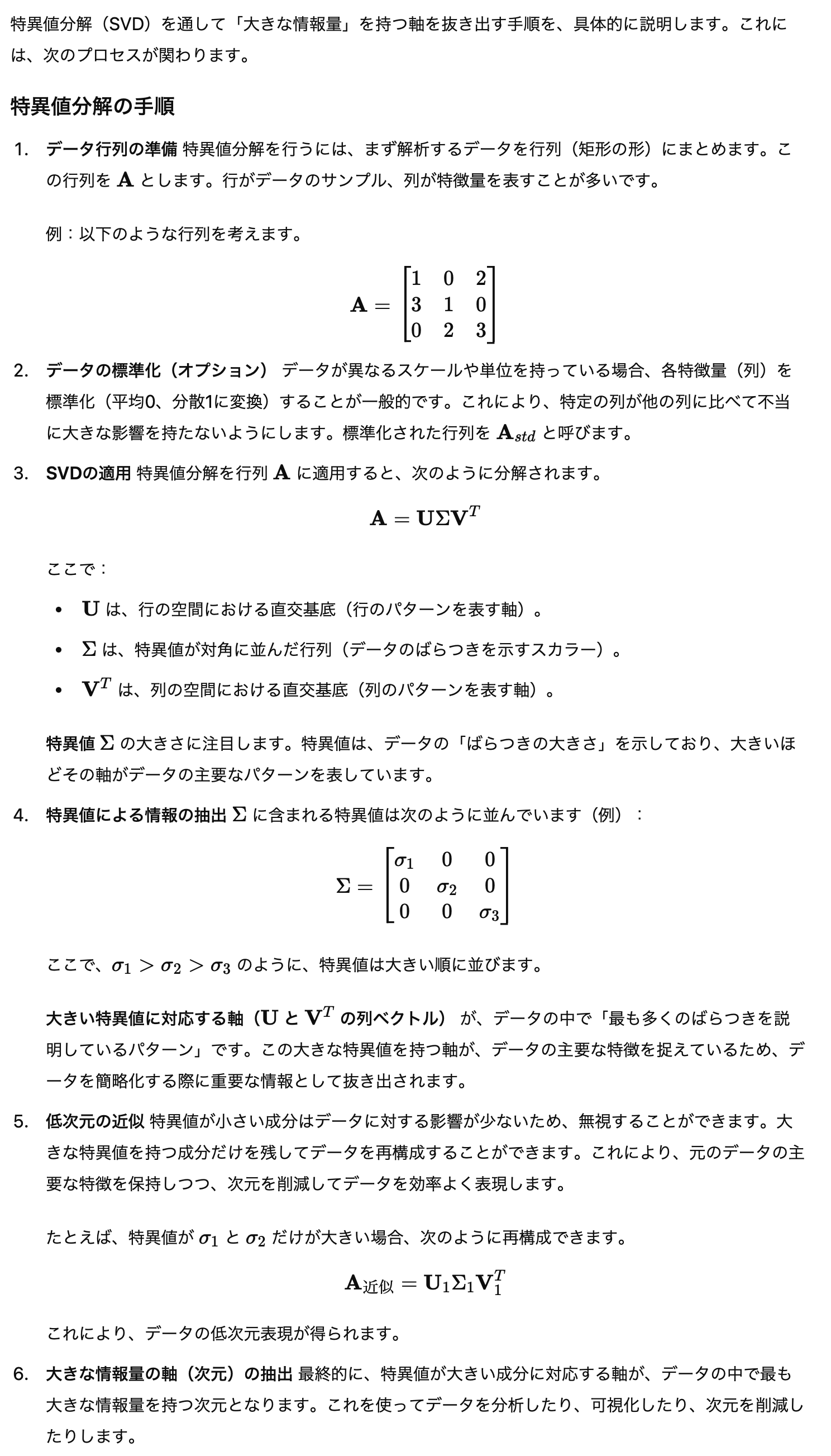

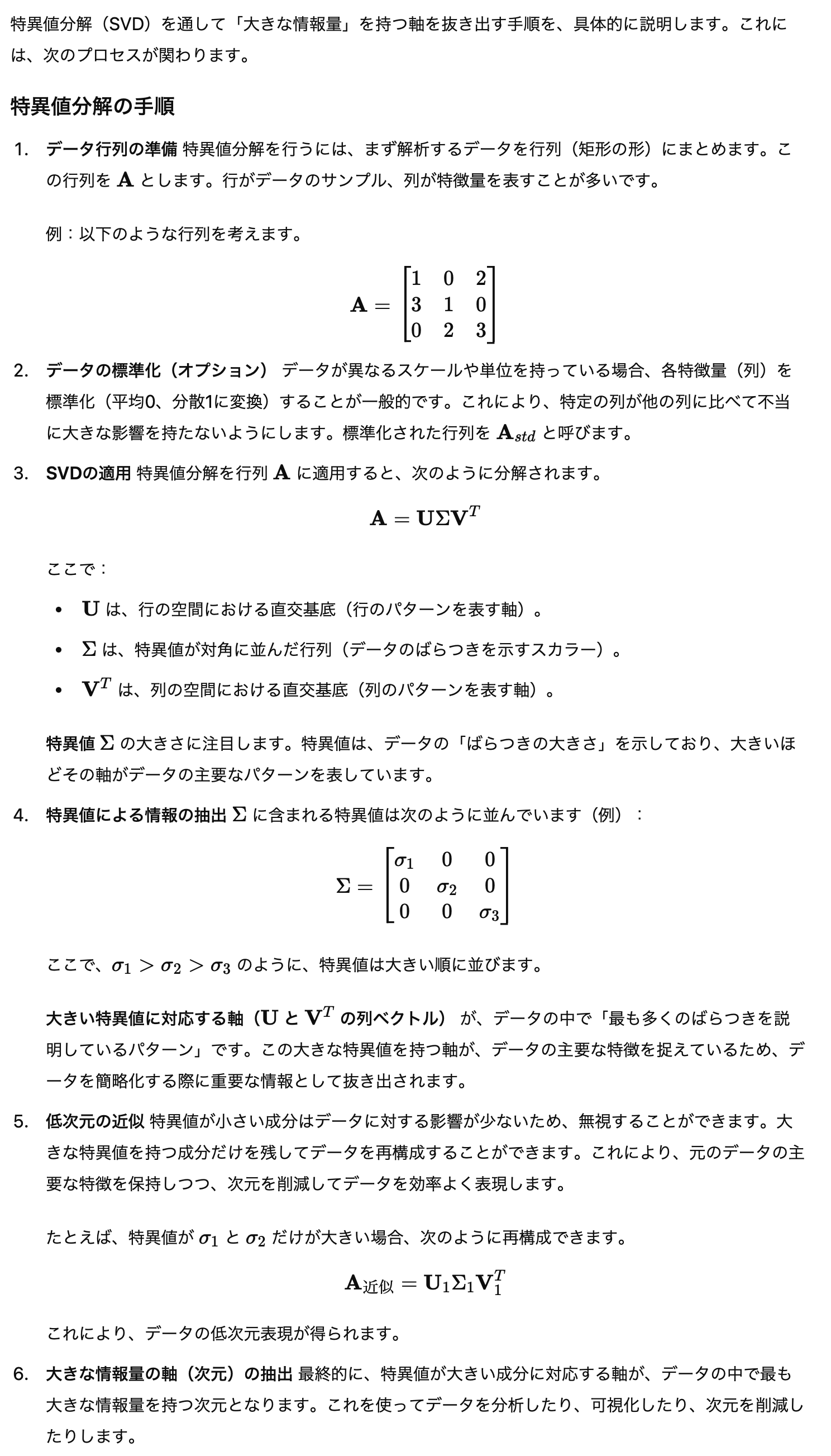

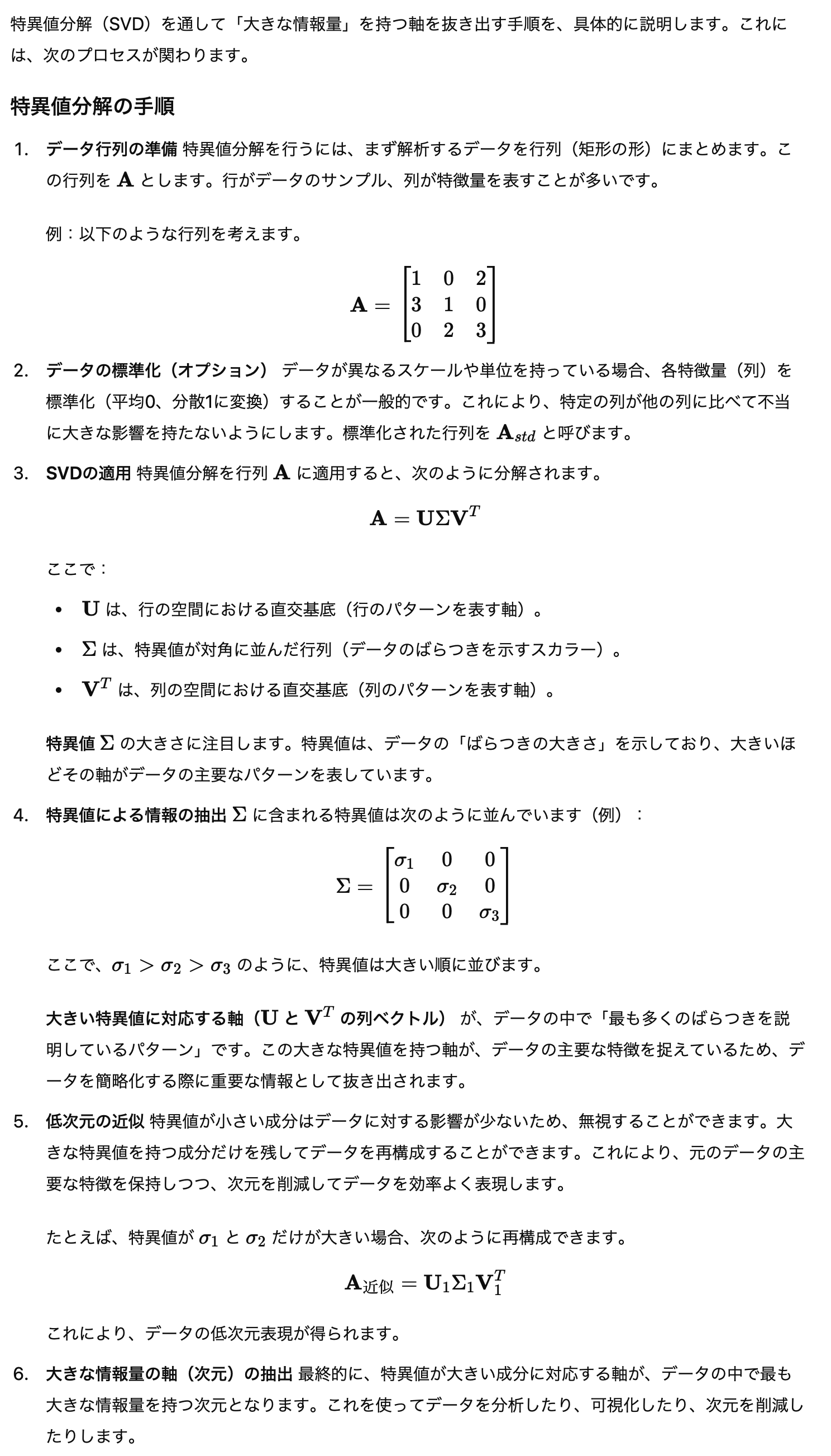

特異値分解(SVD)は基本的に、行列の中で「最も大きな情報量を持つ軸」を抜き出して分解する手法

特異値分解(SVD)は基本的に、行列の中で「最も大きな情報量を持つ軸」を抜き出して分解する手法です。具体的には、行列の構造を解析し、データ内の「ばらつき」や「パターン」を捉えるために、特異値が大きい成分がより重要な軸として扱われます。

特異値は、行列の中でどの成分がデータの「ばらつき」や「特徴」をどれだけ捉えているかを表しており、大きな特異値を持つ軸がデータの中で最も重要なパターンを表しています。SVDの目的は、この重要なパターンを抽出し、データを低次元に圧縮しながらそのパターンを捉えることです。

重要なポイント

- 特異値の大きさが重要です。大きな特異値に対応する軸は、その行列内での「重要なパターン」を示しています。

- 行列の中の「大きな数値」そのものを直接抜き出しているわけではなく、行列全体の構造を解釈して、「どの軸がデータの構造を最もよく説明しているか」を見つけている、ということです。

一般のSVDでの解釈

特異値分解は、一般の行列に対しても同様に適用されますが、その際も行列内の重要なパターンを説明する軸を見つけることが目的です。データに含まれる情報のばらつきを、少ない軸で効果的に表現するため、特異値の大きな軸が「主要な軸」として取り出されます。

具体的なプロセス:

- 行列内の数値を使って、データの相互関係やパターンが特異値分解によって表現されます。

- 特異値が大きい軸は、その行列内で「データの特徴やパターンを説明するために重要な軸」です。

- 大きな数値(つまり大きな特異値)を持つ軸が主要な軸として抽出され、それがデータの構造をよりよく捉えます。

結論

一般の特異値分解でも、コレスポンデンス分析でも、行列内のデータを分解する際に、特異値が大きい軸(つまりデータの主要なパターンを反映する軸)を見出しているという点で一致しています。したがって、SVDは行列の「大きな数値」そのものを抜き出しているわけではありませんが、結果的に大きな情報量を持つ軸を抽出している、という点で質問に対する答えは「はい」となります。

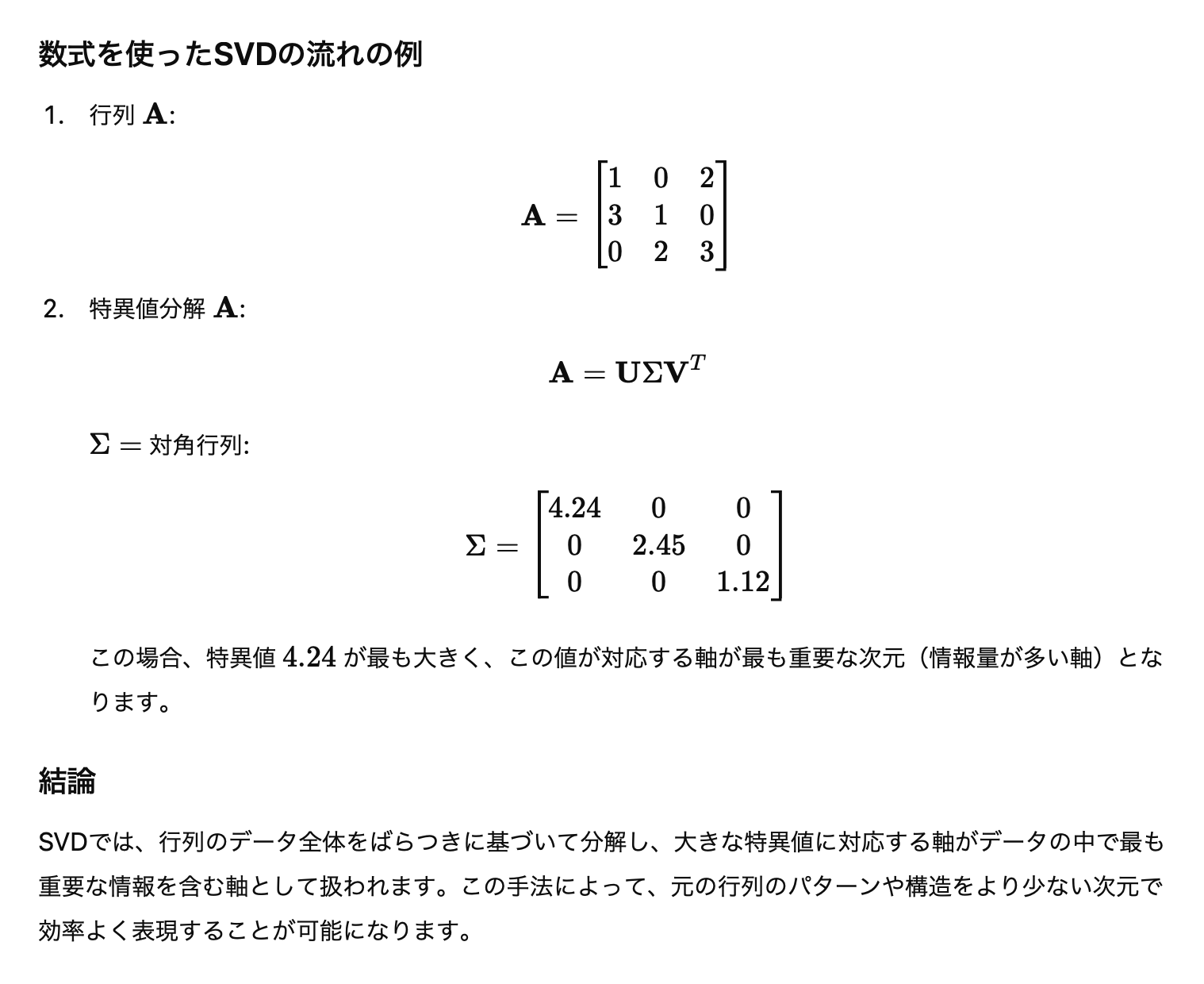

特異値をどうやって出すのかの考え方

特異値を「どうやって出すか」という考え方を簡単に説明します。

特異値とは?

特異値というのは、データの中にある重要なパターンを数値で表したものです。行列全体の情報を「縮めたバージョン」と考えてもいいです。大きな特異値ほど、データの中で重要な部分を反映しています。

どうやって特異値を見つけるのか?

- データをまとめる: まず、データを行列にします。この行列には、いろんな「パターン」(つまり、データの分布や特徴)が含まれています。

- 行列を回転させたり、伸び縮みさせる: SVDでは、行列をいろんな方向に「回転させる」ようなイメージです。この操作を通じて、行列の中の重要なパターンを見つけます。

- 最も情報を持つ方向を探す: 行列の中で、一番「情報量」が多い部分を見つけるのが目的です。特異値は、行列のどの方向(パターン)が一番重要かを教えてくれる数値です。

イメージとしては、行列を「縮めて」、その中で最も「データのばらつきが大きい」方向(軸)を探します。そのばらつきを数値化したものが特異値です。

まとめると

- 特異値は、データの中で一番重要なパターンや方向を示します。

- これを見つけるために、行列を「いろんな方向に回転させて」、どの方向が一番情報量が多いかを探ります。

- 最も情報が詰まっている部分が特異値で、大きい特異値ほど、データの重要なパターンを表しています。

特異値を「データの重要な部分を数値で表したもの」と考えるとわかりやすいです。

「行列を回転させたり、伸び縮みさせる」というのは?

「行列を回転させたり、伸び縮みさせる」というのは、データが持っている情報(パターン)を効率的に表現するために、行列の中で次のような変換を行うイメージです。

1. 行列を回転させるとは?

行列の中の「データの方向」を変えることを意味します。例えば、データがどの方向に広がっているのかを見つけるために、データの軸(行や列)を新しい方向に回転させます。これをイメージとして捉えるなら、元のデータ空間を「適切な角度に回転させる」ことで、データが最も広がっている方向(情報が多い方向)を探す感じです。

具体例:

2次元空間でデータ点があるとします。最初は、縦(y軸)と横(x軸)の方向でデータを見ているとします。でも、データが斜め方向に広がっていたら、x軸やy軸をそのまま使うのは効率的ではありません。この場合、軸を斜め方向に回転させると、データの広がりをよりはっきりと見つけられます。

SVDでは、このように「データがどの方向に一番広がっているか」を見つけるために行列を回転させる処理を行います。

2. 伸び縮みさせるとは?

「伸び縮みさせる」というのは、データの広がり(情報量)を測ることです。特定の方向にどれだけデータが広がっているか、その「ばらつき」を調べます。SVDでは、このばらつきの大きさが「特異値」として現れます。

- 伸びる = データがその方向に大きく広がっている(情報が多い)

- 縮む = データがその方向にあまり広がっていない(情報が少ない)

特異値分解では、この「データの広がり」を数値化して、その情報を軸として抽出します。

まとめると:

- 回転させる:データがどの方向に一番広がっているかを探すために、データの軸(行や列の方向)を回転させて見つける。

- 伸び縮みさせる:その方向にデータがどれくらい広がっているか(ばらついているか)を測る。それを数値化したものが「特異値」。

このようにして、SVDはデータの中で最も重要な方向(軸)と、その方向にどれだけデータが広がっているか(特異値)を見つけます。

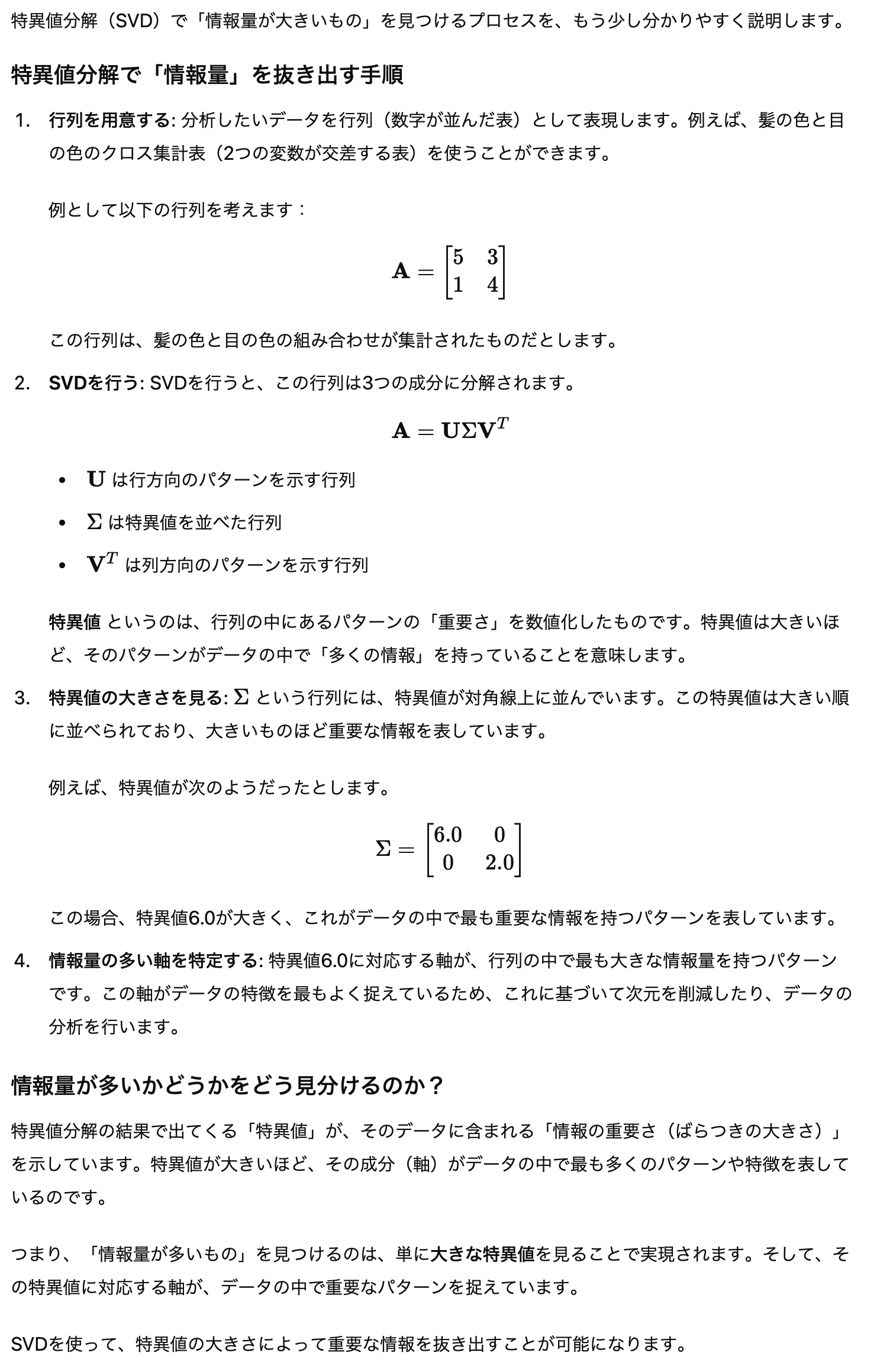

具体的にクロス集計表を使って、どうやってデータを「回転させる」かということに焦点を当てて説明します。

まず、大前提として特異値分解(SVD)の「回転させる」という考え方は、データを新しい基準(軸)に従って再配置するということです。これを数式抜きで、クロス集計表の事例でわかりやすく説明します。

クロス集計表の例

例えば、髪の色と目の色のクロス集計表が以下のように与えられています。

| 青い目 | 緑の目 | 茶色の目 | |

|---|---|---|---|

| 金髪 | 10 | 5 | 2 |

| 茶髪 | 4 | 8 | 10 |

| 黒髪 | 1 | 3 | 15 |

この表は、髪の色と目の色の組み合わせで数をカウントしています。このデータには、髪の色や目の色に関してある種のパターンや相関関係が隠れているかもしれません。しかし、今のままだと、それがどの方向に強く現れているかを直感的に捉えるのが難しいです。

データの回転とは?

SVDの回転とは、「どの方向にデータが広がっているか(相関が強いか)」を見つけるために、既存の行や列の基準を変えて、もっとデータの特徴を捉えやすい基準に切り替えることです。

- データを回転させる目的:

- 現在の「髪の色」や「目の色」という基準では、データのパターンがはっきり見えない。

- そこで、データを別の基準で見ると、隠れた相関やパターンが浮かび上がるかもしれない。

- つまり、今の「髪の色」や「目の色」という軸から、新しい「回転した」軸を見つけ、それに沿ってデータを再配置するという考え方です。

行列を回転させるとはどういうこと?

ここで、データの「回転」をクロス集計表で直感的に説明します。

- 髪の色と目の色の関係を新しい軸で見る:

- 例えば、「金髪」と「茶髪」のデータが似ているなら、髪の色を区別するのではなく、「金髪と茶髪」を一つのグループとして見た方が良いかもしれません。

- 同様に、「青い目」と「緑の目」のデータに強い相関があるなら、それらを一つのグループとして新しい軸で見る方がデータの本質を捉えやすいでしょう。

- 回転後の新しい軸:

- 回転することで、元々は「金髪」「茶髪」「黒髪」などの元の分類だったものが、新しい基準(例えば「明るい髪 vs 暗い髪」)に変わります。

- この新しい基準は、データの中でどのパターン(どの組み合わせ)が最も多く現れているか、どの特徴が最も重要かに基づいています。

クロス集計表での「回転」の考え方

実際に行列を回転させると、以下のようなイメージです:

- 元々「髪の色」「目の色」という区別で見ていたデータが、「髪の色と目の色が似ているグループ」という新しい基準に回転します。

- この新しい基準は、元の行列の中で最も強い情報(パターン)を反映しています。例えば、「金髪」と「青い目」の組み合わせが非常に多いなら、その方向に軸が回転します。

この回転を数式上でやるのがSVDのプロセスです。データをそのままの形で見るのではなく、元の軸(髪の色、目の色)を最適な軸に再構成して、情報量が最も多いパターンを見つけます。

まとめ

- 回転するとは? データがどの方向に最も強く広がっているかを見つけるために、新しい軸を作り、その軸に従ってデータを再配置することです。

- クロス集計表での回転:髪の色や目の色といった既存のカテゴリをそのまま使うのではなく、データのパターンに基づいた新しい基準(軸)を作り、その方向にデータを再配置します。

SVDでは、この「最適な軸」を数値的に見つけ、行列を回転させてデータを効率的に表現します。

特異値分解 (SVD) では、最初に行や列、または特定のセルの数値に直接着目して「最大の数値を探す」という方法ではありません。むしろ、行列全体を統計的・幾何学的な手法で扱い、情報量の多い部分(軸)を自動的に見つけ出すプロセスです。どうしても「最大値に着目して始める」感覚で捉えたい場合は、次のように解釈できるかもしれません。

大きな値に依存しない理由

SVD は行や列、あるいは個々のセルの「大きな数値」に直接依存せず、行列全体のパターンに基づいてデータの構造を探ります。つまり、特定の要素ではなく、行列全体がどのような構造を持っているのかを調べ、その構造を最もよく説明できる「軸」を見つけていきます。

特異値分解の具体的な流れと「大きな情報量の発見」

- 行列の全体を見る: 行列全体を「どの行と列が似ているか」「どのパターンが共通しているか」を見つけるために処理します。大きな数値だけでなく、全体的な関係性が重要です。

- 軸(方向)の見つけ方: 特異値分解では、行列を回転させたり、伸び縮みさせることで、元の行や列のデータの中で、最も重要なパターンや特徴を見つける「方向(軸)」を探します。この軸は、行列全体の中で「どの方向に情報が集中しているか」を示します。

- たとえば、SVDを行うと、元の行列のデータが新しい軸で再表現されます。

- 特異値が大きい軸ほど、元のデータに含まれる情報の多くを説明します。つまり、特異値の大きい方向に向けて、データの「重要な特徴」が集まっています。

- 特異値行列 (Σ) が示す情報量: SVD の結果として得られる特異値行列 Σ には、対角線上に特異値が並んでいます。この特異値は、どの軸がどれだけの情報量を持っているかを示しています。特異値が大きいほど、その軸が元の行列の特徴をよく説明します。

- 最も大きな特異値に対応する軸が、元の行列のデータの特徴を最もよく捉えています。

- 次に大きな特異値に対応する軸は、最も大きな軸が説明できなかった次の重要な特徴を捉えています。

具体的に何を見つけるのか?

SVD の結果として、行列に含まれている「隠れたパターン」を見つけます。これにより、次のようなことが可能になります:

- 行や列の似たパターンの発見: たとえば、髪の色と目の色のクロス集計表では、ある髪の色と目の色が似たパターンを持つことが分かるかもしれません。これが新しい軸として発見されます。

- 元の行列の情報を圧縮: 最も重要な特異値を持つ軸だけを使って元の行列を再構築すると、データの主要なパターンを保持しつつ、次元を減らして効率的に情報を扱うことができます。

簡単に言うと…

- 特定の行や列、セルの「大きな数値」に着目するわけではありません。

- 代わりに、全体のデータのパターンを見つけるために行列全体を調べ、特異値分解を使って、そのパターンを最もよく説明できる「軸」を見つけます。

- 最も大きな特異値に対応する軸が、データの主要な特徴を最もよく捉えている軸です。

これが「大きな情報量を抜き出す」というプロセスです。

似たパターンを見つけるためには、特異値分解 (SVD) の結果から元のデータの特徴を要約し、データ内の「関連性」や「パターン」を発見していきます。SVDがどのようにパターンを見つけるかについて、もう少し簡単に説明します。

1. 行列の構造を見る

SVDでは、行列の全体を見て、どの行や列が似た構造を持っているかを探します。たとえば、髪の色と目の色のクロス集計表があれば、髪の色が似ている人々の目の色のパターンを見つけたい場合があります。

2. 行列を回転させる

行列を「回転させる」とは、データの見方を変えることです。SVDは行列を回転させて、行と列が「どの方向で強く関連しているか」を見つけます。この回転は、データの重要な方向(軸)を探すプロセスに相当します。

- この「重要な軸」は、似たパターンを示す方向になります。元の行や列のデータがどの方向に関連しているかを示しており、関連性が強い行や列がこの軸に沿って配置されます。

3. 特異値を使って情報量を評価

SVDでは、特異値(行列の中の特定の値)がデータのパターンの強さを示します。特異値が大きいほど、その軸がデータをよく説明していることになります。これによって、行と列がどのように関連しているかが分かります。

たとえば、髪の色と目の色のクロス集計表で、ある髪の色とある目の色の組み合わせが特異値分解によって見つけられれば、それらが似たパターンを持っていることが分かります。

4. 似たパターンの見つけ方:ベクトルの距離

SVDの結果として、元の行や列は「ベクトル」として新しい軸上に配置されます。このベクトルの長さや方向が、行や列のパターンを示します。似たパターンを持つ行や列のベクトルは、似た方向に向いており、そのベクトルの距離が近いことを意味します。

- ベクトルの距離が近い:行や列のパターンが似ていることを意味します。

- ベクトルの距離が遠い:パターンが異なることを意味します。

5. 次元削減による視覚化

SVDを使って、次元削減を行い、データを2次元や3次元に圧縮することができます。これにより、元のデータを視覚的に理解しやすくなります。似たパターンを持つ行や列は、圧縮された空間でも近くに配置されるため、データ内のパターンが視覚的に確認できるようになります。

簡単に言うと:

- 行や列が似ているかどうかは、特異値分解によって見つけた軸上での配置(ベクトルの向きや距離)を使って判断します。

- 特異値分解の結果、似たパターンを持つ行や列は、新しい軸で近くに配置され、共通のパターンを見つけやすくなります。

これが、SVDを通じて「似たパターン」を見つける方法です。

SVD(特異値分解)は基本的に「直交回転」を行う手法で、得られる新しい軸(固有ベクトル)は互いに直交しています。つまり、各軸は他の軸と独立しており、軸同士に相関はありません。

一方で、斜交回転(oblique rotation)は、軸が互いに直交していない場合、つまり軸同士に相関があることを許容する方法です。これは特に因子分析の分野でよく使われます。斜交回転では、異なる軸がある程度相関を持っている可能性があるデータに対して、より柔軟にデータ構造を解釈できるようにしています。

直交回転と斜交回転の違い

- 直交回転(orthogonal rotation):

- 各軸が互いに独立しており、軸間に相関はない。

- 特異値分解や主成分分析(PCA)など、基本的にデータを互いに独立した成分(軸)で表現しようとする。

- より単純で、計算が容易。

- 斜交回転(oblique rotation):

- 軸同士に相関があることを許容する。

- データの因子が完全に独立していない場合、斜交回転を用いるとより現実に近い解釈ができることがある。

- 因子分析などで、より複雑なデータ構造を捉えるために使われる。

SVDと斜交回転

SVDでは、元のデータ行列を直交ベクトルに分解するため、各軸が独立しています。これは、SVDが「直交回転」に基づいているからです。もしデータの構造が、相関のある軸を持つ場合や、相関を許容する解釈をしたい場合には、SVDではなく因子分析や斜交回転を使用することが適切です。

したがって、SVDは「直交回転」を行い、軸同士に相関がない形でデータを解釈しますが、斜交回転を使う場合は、軸同士に相関があっても良いとするアプローチになります。

===

|

|

|

"make you feel, make you think."

SGT&BD

(Saionji General Trading & Business Development)

説明しよう!西園寺貴文とは、常識と大衆に反逆する「社会不適合者」である!平日の昼間っからスタバでゴロゴロするかと思えば、そのまま軽いノリでソー◯をお風呂代わりに利用。挙句の果てには気分で空港に向かい、当日券でそのままどこかへ飛んでしまうという自由を履き違えたピーターパンである!「働かざること山の如し」。彼がただのニートと違う点はたった1つだけ!そう。それは「圧倒的な書く力」である。ペンは剣よりも強し。ペンを握った男の「逆転」ヒップホッパー的反逆人生。そして「ここ」は、そんな西園寺貴文の生き方を後続の者たちへと伝承する、極めてアンダーグラウンドな世界である。 U-18、厳禁。低脳、厳禁。情弱、厳禁。